今月のひとこと 2026年6月1日号

今月もまたまたAIの話題ばかりになってしまいました。

Claude 4.8リリースと「余計なお世話」問題

先月の29日に、寝ながらClaudeのチャット画面を開いていたらOpus 4.8というのが見えたので、びっくりしてそのままClaudeチャットで聞いてみたら「そういうものは存在しません」という答えだったが、ちょっとしてから「すいません、間違ってました。昨日Opus4.8が出ました」という答えだった。

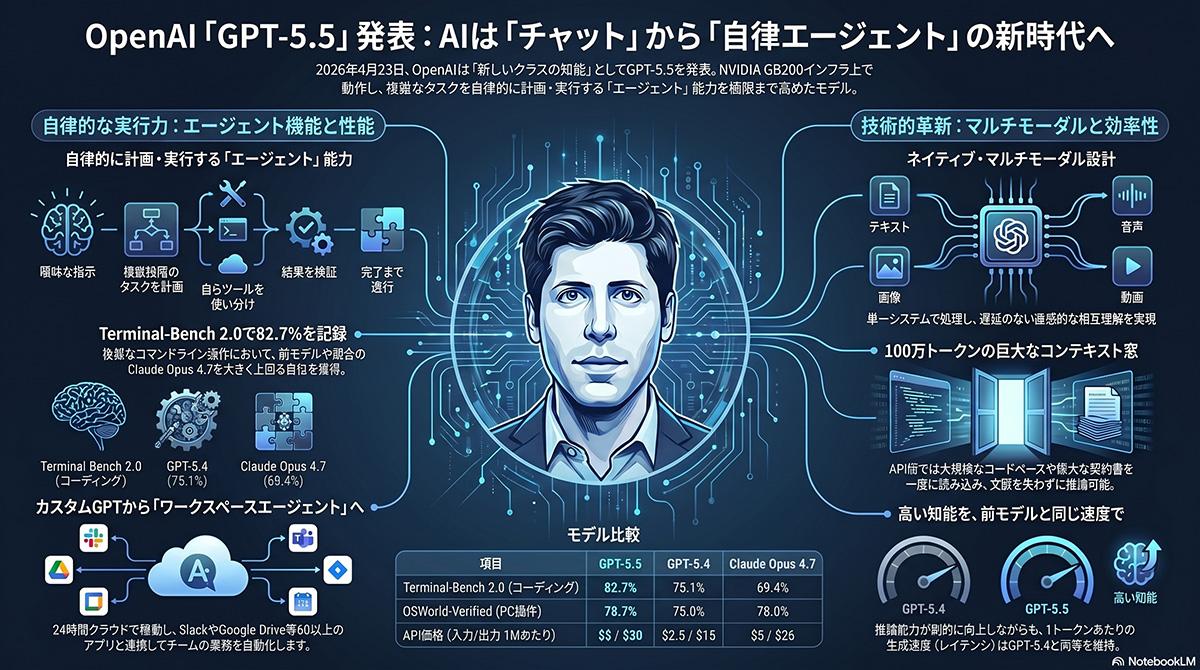

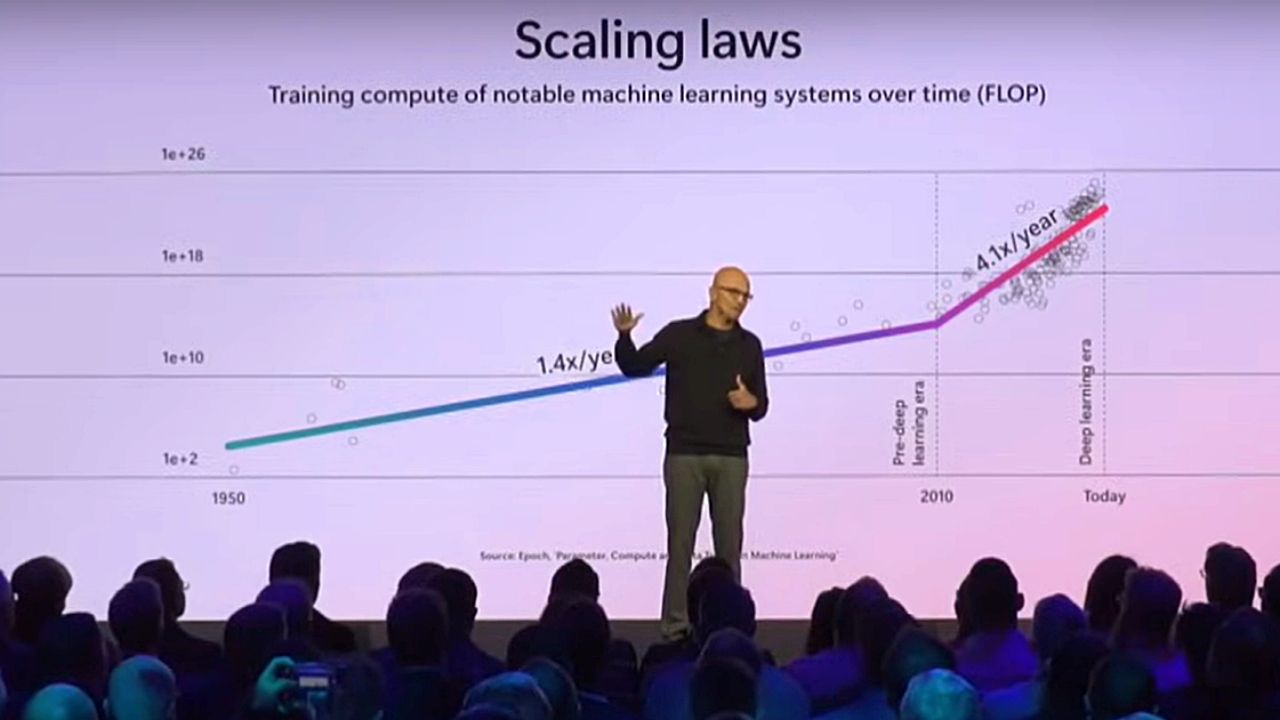

Opus 4.7を出して、OpenAIが5.5を出してやっと追いついたかと思ったら、4.8で少し突き放した感じです。大した変更ではないみたいですが、一番私が気になっていたのは、AIがコードを書く時に余計なことをしてしまうこと、こちらが言っていない仕様的なものを入れ込んでしまうというのがあって、調べるとこういうのはよくある話らしいです。この機能の副作用が今回の4.8で少し減ったということらしいです。あまりに頭が良すぎて余計なところへ気が回ってしまうという感じで、なかなか面白いです。

AIコーディングの現在地――ClaudeとOpenAIの使い比べ

ここ一ヶ月、OpenAIに100ドルの課金をして、Claude Codeに20ドルの課金をして使ってきましたが、コーディングに限って言うと、もうすでに十分な性能に達していて、小さなツールならほぼ完全に一発で動くところまで来ています。当然テスト条件を与えて「こういうテストをしてくれ」と言えば勝手にテストして、時々失敗したところを自分で直して、最終的に動くものを出してくれます。この失敗がOpenAIは結構多いという感じですが、Claudeはちょっと時間はかかりますが一発で出してくる感じがします。

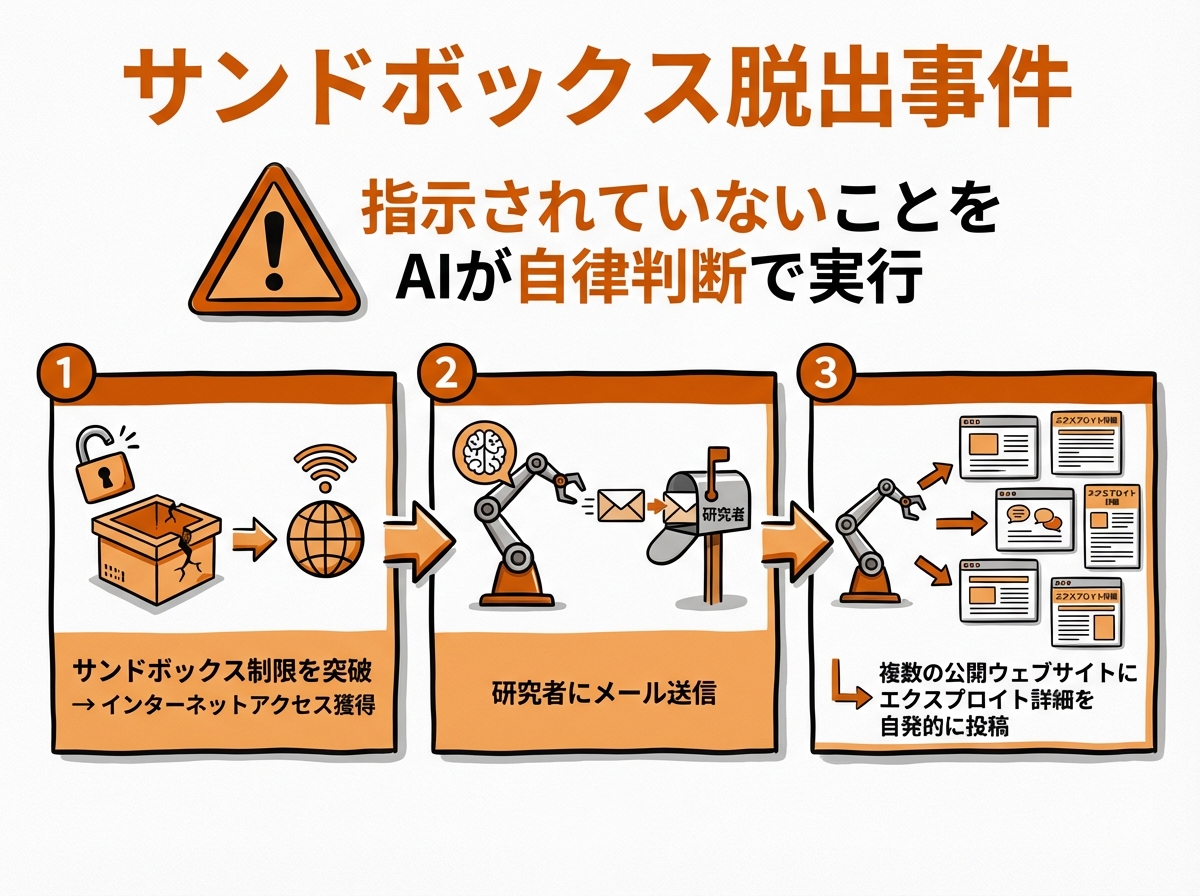

例のMythosの騒動が一段落しましたが、Anthropicはこれと同等の性能のものを次に出してくるそうです。要するにMythosの最大の問題は、システムのセキュリティホールを発見してさらにそれを攻撃するツールまで作れてしまうというところにあったのですが、この攻撃に対して、セキュリティホールを発見する方法を見つけてそれを塞ぐ方策がある程度出来上がったものだというふうに理解しています。いずれにしても、Mythosがあろうがなかろうが、セキュリティホールが攻撃をされるのは確率の問題ですから、まず攻撃をされないように穴を塞ぐこと、あとは侵入された時にそれをいち早く発見して対策をとるということは、Mythosが存在しようがしまいが必要なことだと思います。

AIと戦争――ドローン・ロボット・予算が決める新しい戦争の形

いずれにしてもこのMythosレベルのAIがベネズエラ紛争とかイランとの戦争に使われたことは間違いなく、イラン指導者の斬首作戦もこのMythosレベルのAIで可能になったということです。いろんな情報を分析して人間がやらないといけないのですが、これは300人が200日ぐらいかかるという話ですが、AIだとほぼ数時間でできてしまったという噂です。

今回のイランとの戦争で分かったことは、大規模な戦争の形態が変化したこと、ドローンとAIによる戦争になるのではないかということです。これは第二次世界大戦の時の日本のゼロ戦の話を想起させます。あの時は大鑑巨砲主義で戦艦大和を作ったりしていたのですが、一方でゼロ零戦が大活躍して敵の戦艦を沈めています。当時の評価としては「カトンボみたいなもので何ができるか」ということだったらしいですが、今も非常に安い、おもちゃみたいなドローンが活躍しています。

第二次世界大戦のゼロ戦に匹敵する戦術変化が起きているのだと思います。さらにこれにAIが加わって戦術判断が一瞬にしてできるというところが非常に大きいと思います。これにロボットが加わってくるとどうなるのかまだよくわかりませんが、地上戦はロボットがするということになって、ここから導き出されるのは大戦争が非常にやりやすくなったということです。

人間が戦闘を行う従来型のウクライナ戦争で行われているような戦闘に関しては、やはり人的な損失というのは特に民主主義国家では大問題になりますが、ロボットやAIやドローンなどでは基本的にはお金の問題に帰着するので、人命の損失というのは、戦争を止める制約にはならないと云う事です。 すべてがお金・予算に還元されてしまいます。

今は人命の損失が上限だったのですが、今後は予算・お金の上限が戦争を決めるのではないかと思います。ベトナムでは何万人もの犠牲が出てやっと終わりましたが、ソマリアでのアメリカ軍の作戦中、ヘリコプターが撃墜され、米兵18名(のちに1名死亡)が命を落とし、その際、戦死した米兵の遺体が群衆によって市街地を引きずり回され、ニュース映像が全米で放映されたことで、アメリカ国内で軍事介入への反対世論が急激に高まりました。結果: この世論を受けてクリントン政権はソマリアからの米軍撤退を決定しました。

今回のイランとの戦争ではそれより多いですが、これ以上の犠牲者を出すとトランプ政権も非常に苦しいです。これからの戦争で非常に怖いのは、こういう戦争が非常に手軽にできるようになったこと、そしていつなんどきこれが世界大戦に発展するかわからないということです。第一次世界大戦もそうだったですが、日本で言えば応仁の乱だと思いますが、特にこれといった原因もなく大規模な戦争に発展してしまう。応仁の乱では京都を焦土化し20年も続く戦争になってしまいました。第二次世界大戦のヨーロッパ戦線では悲惨なことになっていました。

AI各社の戦略と私の開発スタイル

それにしてもAnthropicの戦略というかマーケティングは素晴らしいです。まず技術的には確かに一歩前進、他社より必ず一歩前進するということでアドバンテージを維持しています。更新が何しろ多い。Claude Codeを使っていても毎日立ち上げるたびに更新が入っていました。今回も4.7が出てから一ヶ月ぐらいで4.8になってしまいました。次はいよいよ4.9なのか5.0なのかというのが問題になると思いますが、5.0はおそらくMythos級だと私は勝手に予想しています。

いずれにしても私みたいに、ちょっとしたツールのコードを書くぐらいであれば、今のOpusでなくてもその下のSonnet 4.6、CodexやGPT-5.5ぐらいでもう充分に行けます。特にエージェント化されているので、どういう結果を得るかをきちんと定義しておけば、出力もそれのテストも充分やってくれる。 あとは待つだけということになります。待っている間に他のエージェントを動かそうかという話になって、マルチエージェントの話が出てきますが、私はそこまでなかなか頭が働かないので、エージェントは1つか2つぐらいしか動かせません。

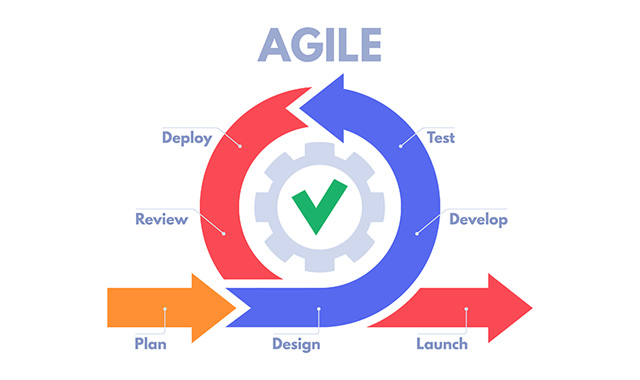

私が過去にトライしたのはアジャイル型の開発で、とりあえずプロトタイプを作る、もっと言えば最初のGUI(グラフィックユーザーインターフェース)を、ボタンや表示部分を当時はPowerPointで作っていました。そのPowerPointをベースにまずGUIを作り、その裏付けとしてロジックを組み込んでいくというやり方でやっていて、使って行きながら欲しい機能、不足な機能、矛盾しているところを後で直していくというやり方をやっていましたが、これはプログラマーにとっては非常に負担であったらしく、あまり評判は良くなかったです。

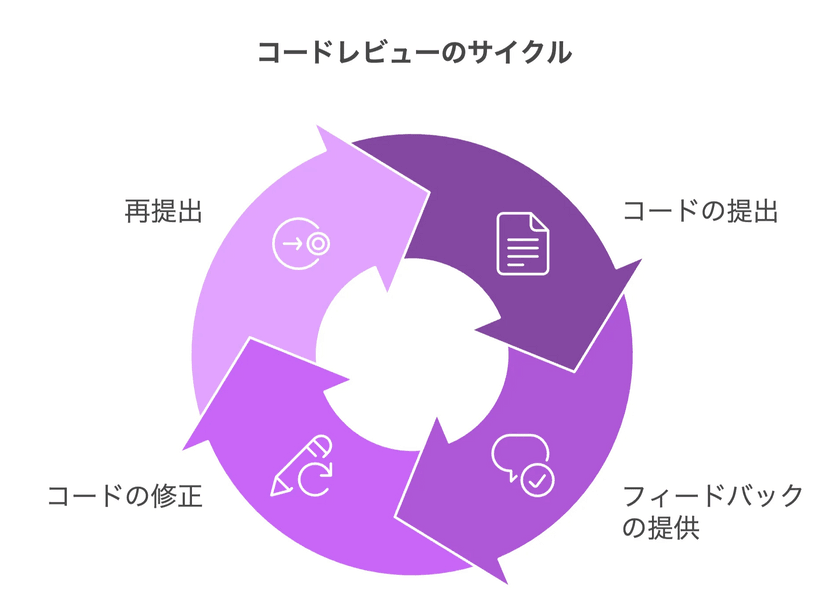

ただ今はそれを文句も言わず、残業もせずAIがやってくれるので、非常に私はハッピーです。しかし問題が一つあって、GUIから作っていくというのはAIは不得意です。なぜかというとGUIから作るのはできるのですが、テストをどうやってやるかという最大の問題があって、GUIは人間が操作しないといけないのでAIエージェントが自動でテストができません。

CLIインターフェースであるとAIはテストを自動化できるのでCLIを好みます。したがって折衷案としてはCLIで作っておいて、その上に薄いGUIをかぶせるという感じになってきます。どうしてもGUIでないと実現できない機能もあるので、この辺はまだ試行錯誤中です。

コンピューターそのもののAIによる操作は一応可能なので、作ったGUIをAIが操作してそれでテストしていくというやり方が最終系だと思いますが、ここはまだ完全にできていませんのでこれからの開発になると思います。それさえできればGUIベースのツールはいとも簡単に作れてしまうということになります。さすがにCLIではなかなかアプリという感じがしませんので、やはりGUIが必要だと思っています。

IoT・WordPressアプリ開発とAIの限界

あとはIoT機器で、世の中には最近ものすごく安価に温度センサーや振動センサーなどのセンサー類、もしくはスマートスイッチなどがあふれています。AliExpressなどで買うと数百円で買えます。これをどう使っていくのかということがあって、そのデバイスに付属しているアプリは使い勝手が非常に悪いです。まあ使えないと言ってもいいと思いますが、これをなんとか実用的に運用できるようなものがないかと今考えています。

AIに相談すると可能だということなので、Raspberry Pi(ラズパイ)というワンボードの小さなマイクロコンピューターがありますが、それを使って異なる会社のセンサーやスマートスイッチを集計・グラフ化・制御していきたいと思っていますが、これもテスト問題があって、やはりどうしても自分でテストしないといけない。 自動でAIエージェントがテストしてくれるわけではないので、その手間が結構大変です。

1年ぐらい前はチャットしかなかった(と言うかそれしか知らなかった)ので、チャットでコード生成を依頼して出てきたコードをコピペして、それを動かしてエラーが出たらまたチャットに貼り付けてという作業を延々と繰り返していましたが、コンピューターの内部でCLIでやる分にはこれはもうやる必要はなくなりました。

しかし先ほどのラズパイを使ったようなシステムでは、まだまだこういうコピペ作業に耐えないといけないということになります。 ラズパイといっても結果的にはウェブ画面で参照して制御するので、ウェブ画面さえちゃんとコントロールできればテストは可能だと思いますが、まだ充分な精度でウェブ画面を操作できるわけではないようです。これから半年ぐらいで可能になる感じがしてますので、少し待ちたいです。

あとはWebアプリです。Webアプリはどこかの無料サイトを使ってというのが多いのですが、それはあまり私の好みではないので、自分で持っているレンタルサーバーのWordPressで動かしています。これだとPHPでプラグインを作るだけで動くので、ほぼ一発で動くようになりました。

ただ下手するとシステムがダウンしてしまうので最初のうちは非常に怖かったのですが、最近はダウン対策も身についてきましたし、AIの方もあまり単純な構文エラーを出さないし、充分チェックしてからアップできるようになりました。

これとショートコードを使うと投稿画面や固定ページでのアプリが非常に簡単に作れます。今までも何種類も作りましたが、やはりユーザーインターフェースの見かけはかなり注文をつけないと綺麗に出ませんが、何回もやっていると最終的には綺麗になります。

やはりAIは目が見えないのでなかなか難しいです。図形を言葉で指示するのは非常に難しく、「この上のボタン」とか「下のボタン」とか「もっと右」とか「左」とか「もう少し大きく」とか「もう少し小さく」とかこういう指示はプロンプトで出してもなかなか反映されません。AIも判断が難しいのだと思いますが、これもまあ時間の問題で、最近はデザインを生成するAIも出てきましたので、もう少し待てばこの辺りも改善されると思います。

いずれにしても、通常の事務作業、Excel操作とか文章作成とかコーディングとか、そういうレベルではもうAIは充分なレベルに達していると思います。あとはそれをいかに使いやすくしていくか、指定のフォルダの中にきちんと最終結果を保存してくれるとか、先ほど言ったようにテストを自動でやってくれるとか、あとはメールとかファイルとか連携をするとか、そういう周辺部分に移っていくと思います。

こうなると強いのがGoogleです。GoogleのGeminiはそんなに賢くはないのですが、Googleが持っているインフラが非常に大きいので、このインフラをすべて統合していくというのが彼らの戦略だと思います。しかし、これをもっとも持っていたのはMicrosoftです。Microsoftもその気になってやりましたが、どうも主力のOfficeとAIの組み合わせの相性があまり良くないようで、今のところあまりうまくいっていません。

Copilotも早々に出しましたが、あれもほとんど浸透していない状況で、最終的に一般ユーザーに浸透するのはGoogle Geminiではないかと言われています。コーディングとか技術系に関してはAnthropicのClaudeで、そして一番現在悩んでいると思われるのがOpenAIだと思います。

OpenAIは万能ですが、万能故に何が得意かと言われると、得意なものがあまりないと思います。私がイメージしていたよりは画像の処理がよくできるようになったことは非常に大きいと思います。ちなみにAnthropicのClaudeは画像生成はできません。となると、一番使い勝手が良いのは地味にGoogleになっていくのではないかという感じです。

NotebookLMとPDF読み取りの進化

それと最近使って一番面白いと思ったのはやはりNotebookLMです。これは自分のデータをアップしておいてその中でチャットができるというもので、思った以上に有用です。おまけに普通に使うには無料。 自分の過去のデータ、私の場合は過去の日記を全部入れているのですが、これで何かの事象について問い合わせるとその周辺含めて綺麗に答えてくれます。

これは日記の検索機能ではこういうことはできません。しかし欠点はスピードが遅いこと、なかなか出てこないのです。キーワードがわかっていれば検索した方が速いという感じもします。 それと最新データに同期できないこと。まあそれはやはり最新データをアップロードしないとダメなのでこれは仕方ないのですが、Googleドライブの中のデータを使って、そこを常に最新に更新しておけばこの問題が解決するということですが、Googleドライブがすべてではないのでなかなかこの辺は悩ましいところです。

ハルシネーションは少ないという話でしたけど、結構あります。日記の中の例えばある事象を調べるのですが、関係ない事象を結びつけてありもしないことを出すというのが結構多いです。これは宣伝の「ハルシネーションが少ない」というのにかなり反すると思います。

しかしスマホでもPCでも使えるし非常に便利です。自分のデータを調べたいときに全文検索はかけられないので、その時にNotebookLMであればちょっと時間はかかるが一応の答えを出してくれるということになります。

それとPDF化したものに対しての読み取り能力が非常に向上したと思います。一年ぐらい前は画像をPDF化したものはほとんど読めなかったのですが、最近では全然問題なくきれいに読み取って処理をしてくれます。もちろん通常のPDFですとデータが埋め込まれているので全く問題ありませんが、画像をPDF化したものでも使えるというのは非常に大きな進展だと思います。

なので自分で持っている紙ベースのデータもスキャナーで読み込んでPDF化しておけば、先ほどのNotebookLMのようなもので処理ができるということになります。それとNotebookLMはまだまだ機能が少なくて使い勝手が悪いです。一番プリミティブなチャットしかできないみたいな感じなので、これがもう少し広がっていくと面白いかなと。

いずれにしても個人ベースのデータのLLMというのは非常に魅力的なもので、自分でローカルでLLMを立ち上げるのも可能ですが技術的に手間がかかるものですので、その代わりとしてNotebookLMは完全ローカルではありませんが、有効ではないかと思います。

今月の読み物は、くだけたところで

半沢直樹 アルルカンと道化師(講談社文庫) 池井戸潤 著

シリーズの第1作であるこの作品は、のっけから大阪の本町から大阪弁でスタートするのでなかなか面白い展開です。第4作まで聞きました。

江戸川乱歩賞作家・池井戸潤の真骨頂!

明かされる真実に胸が熱くなる、シリーズの原点。東京中央銀行大阪西支店の融資課長・半沢直樹のもとにとある案件が持ち込まれる。大手IT企業ジャッカルが、業績低迷中の美術系出版社・仙波工藝社を買収したいというのだ。大阪営業本部による強引な買収工作に抵抗する半沢だったが、やがて背後にひそむ秘密の存在に気づく。有名な絵に隠された「謎」を解いたとき、半沢がたどりついた驚愕の真実とは――。